La legge sull'intelligenza artificiale dell'UE è la prima legge generale al mondo su questo tema. Ti aiuteremo a prepararti estendendo i tuoi programmi di governance dei dati, privacy e sicurezza all'uso dell'intelligenza artificiale.

Legge sull'intelligenza artificiale dell'UE

Adotta l'IA e preparati a raggiungere la conformità alla legge sull'intelligenza artificiale dell'UE

Sostieni l'innovazione aziendale e dimostra la responsabilizzazione per quanto riguarda i requisiti normativi della legge sull'intelligenza artificiale dell'UE con la nostra tecnologia di AI Governance.

Preparati a rispettare la legge sull'intelligenza artificiale dell'UE

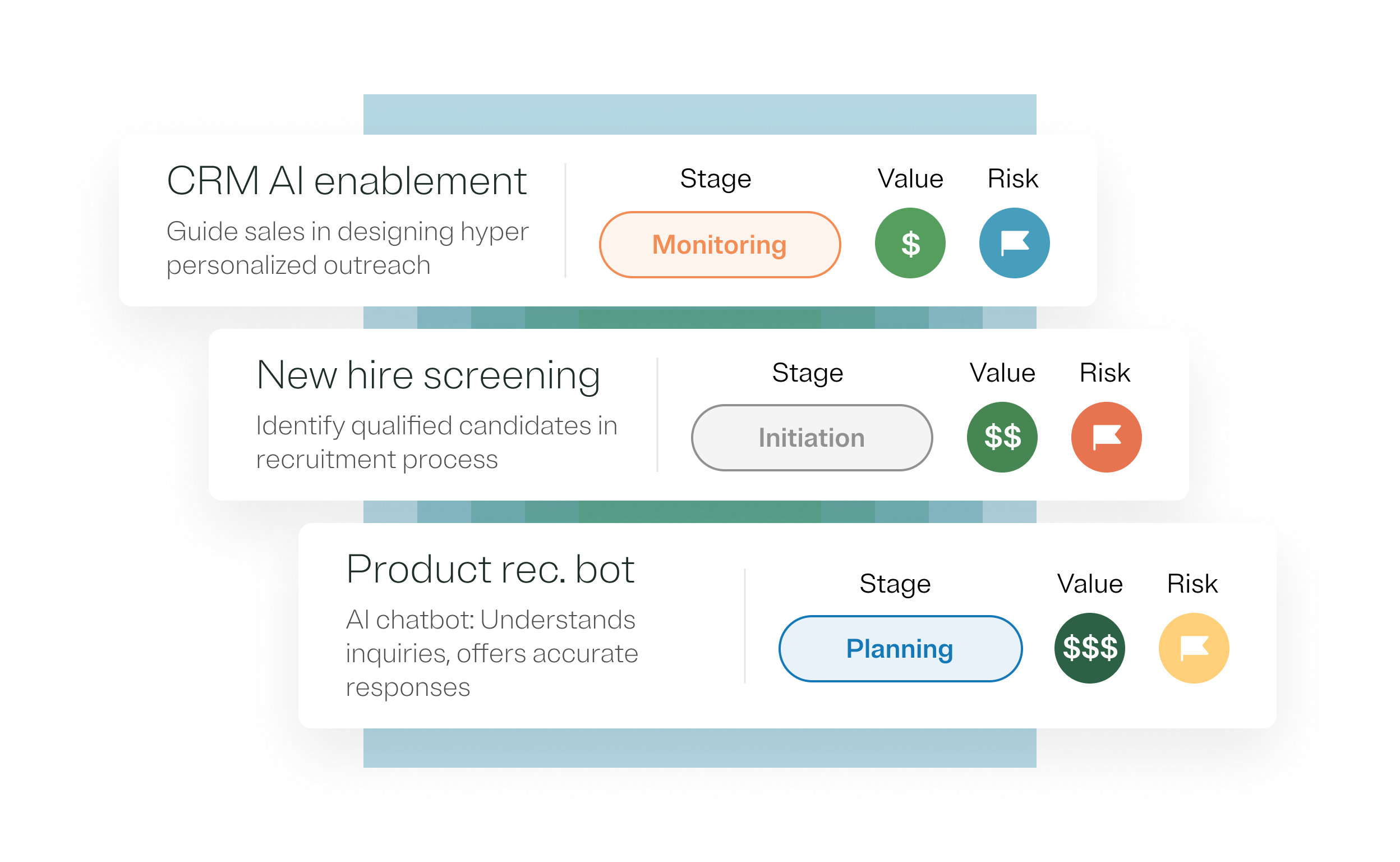

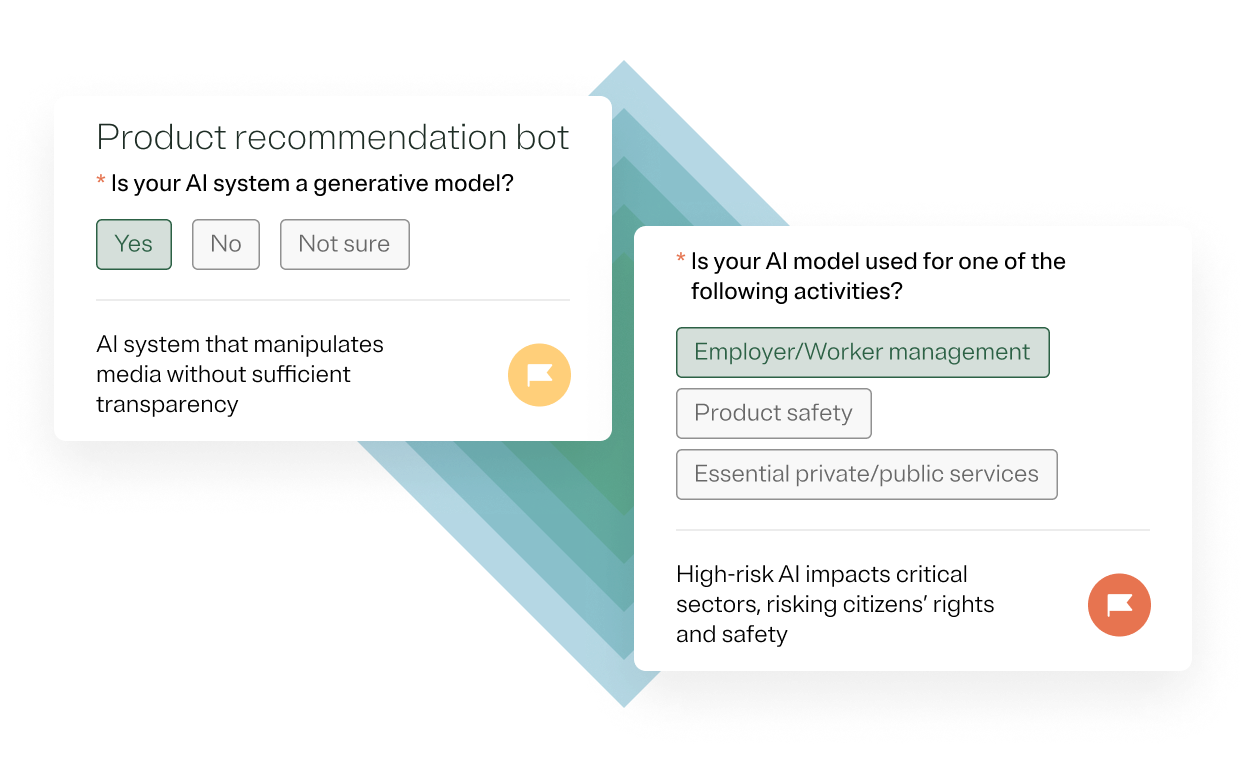

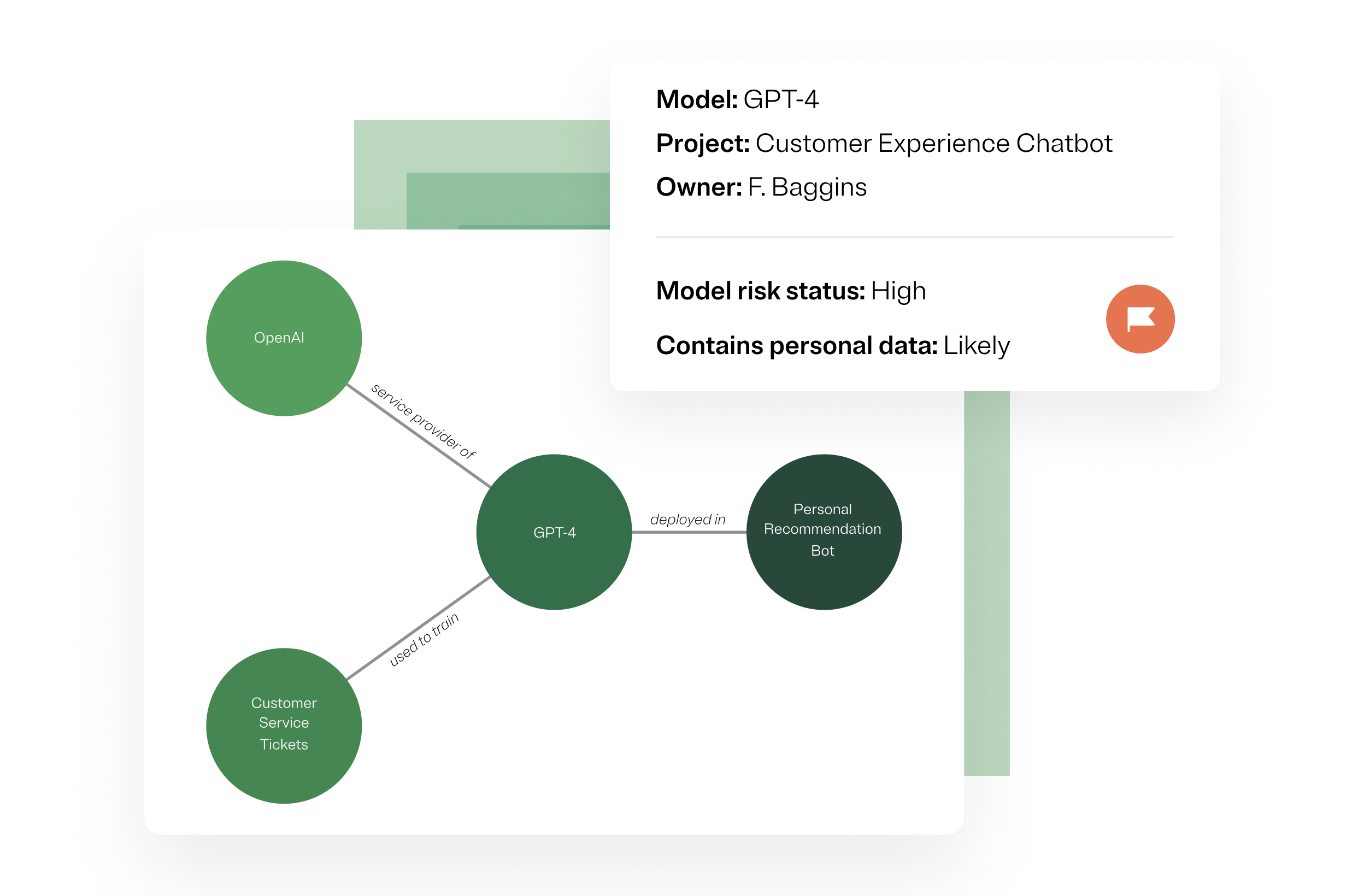

Valuta e classifica i sistemi basati sull'intelligenza artificiale alla luce dei requisiti della legge dell'UE sull'IA e semplifica la valutazione dell'IA utilizzata da terze parti.

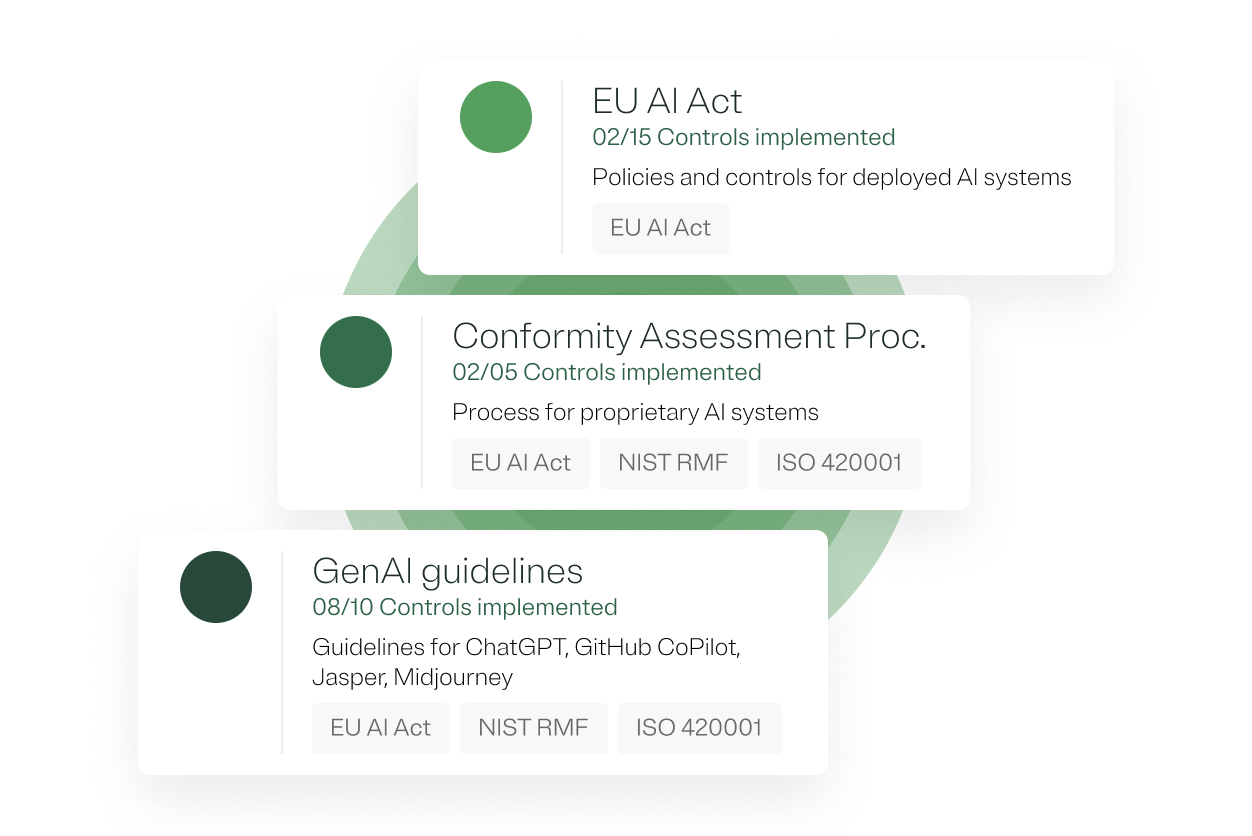

Gestisci la documentazione e le policy per tradurle in controlli tecnici. Attiva facilmente le notifiche, le attività degli utenti e gli aggiornamenti delle applicazioni.

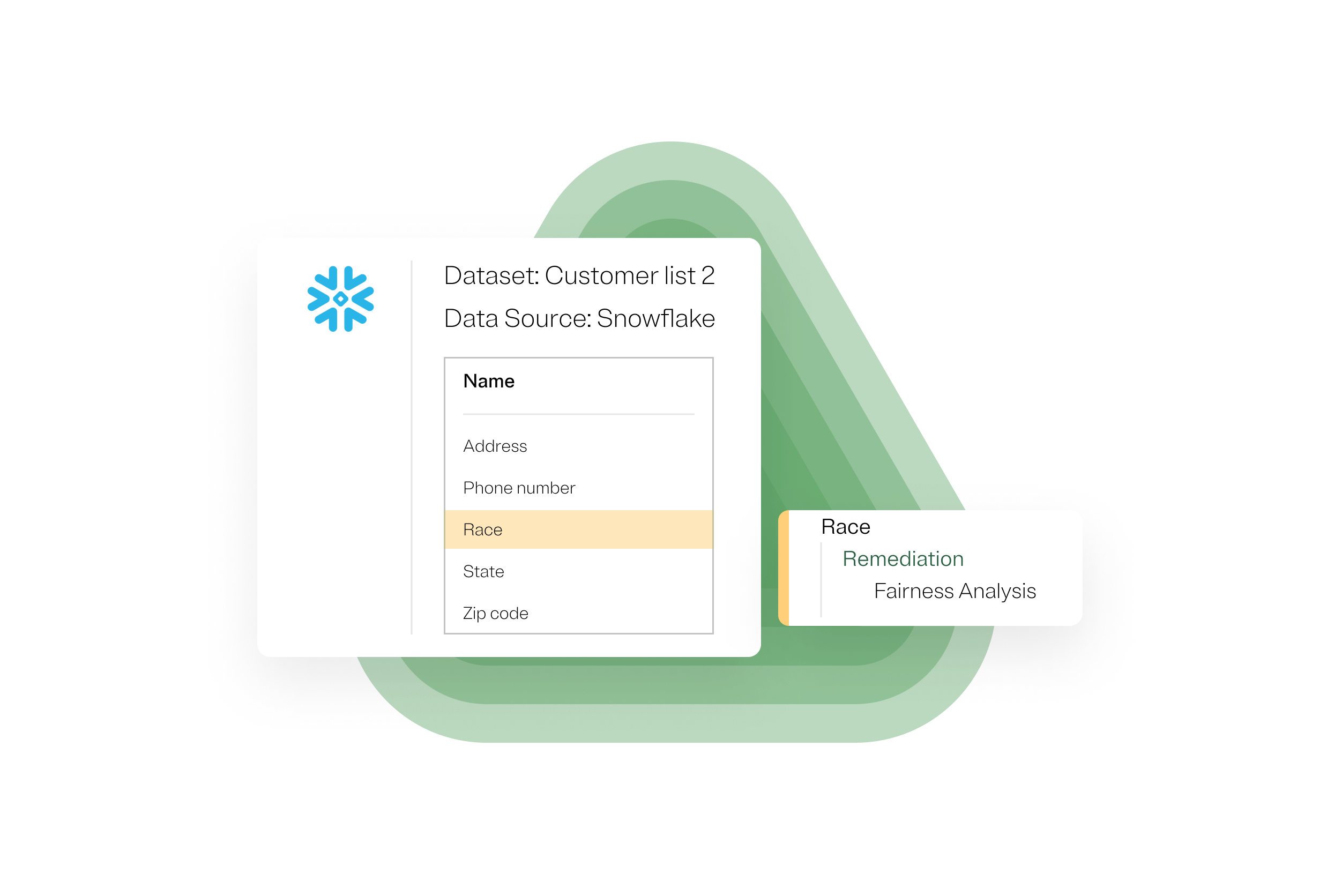

Identifica i rischi nei set di dati di formazione e negli input di riduzione dei rischi. Proteggi ed effettua la governance dei dati nella pipeline di ML attraverso l'applicazione automatizzata delle policy e le azioni correttive.

Genera report, dashboard, valutazioni d'impatto e della conformità dell'intelligenza artificiale e schede modello per le parti interessate, sia interne che esterne.

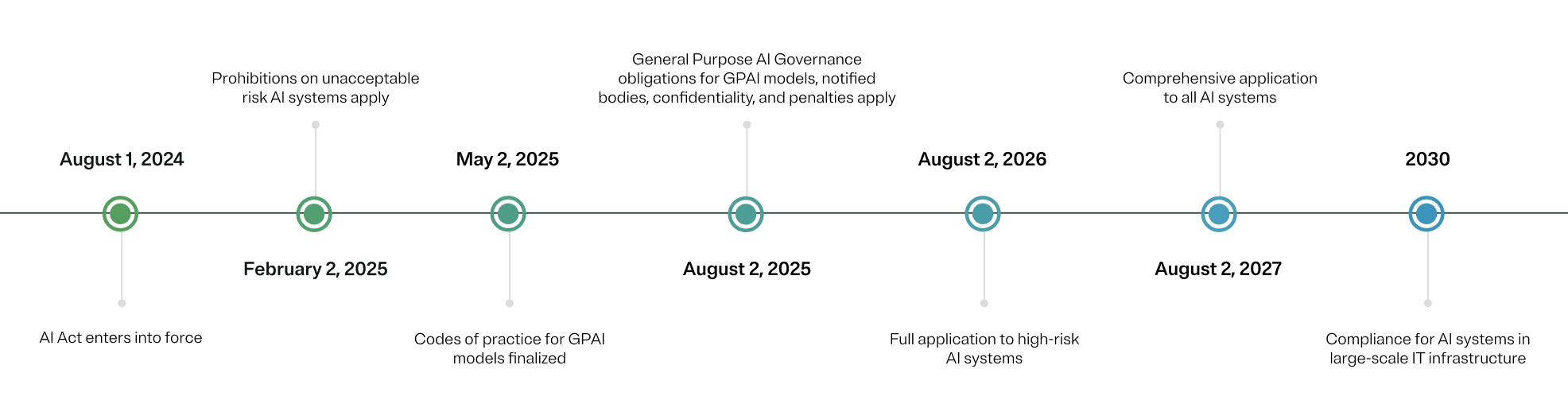

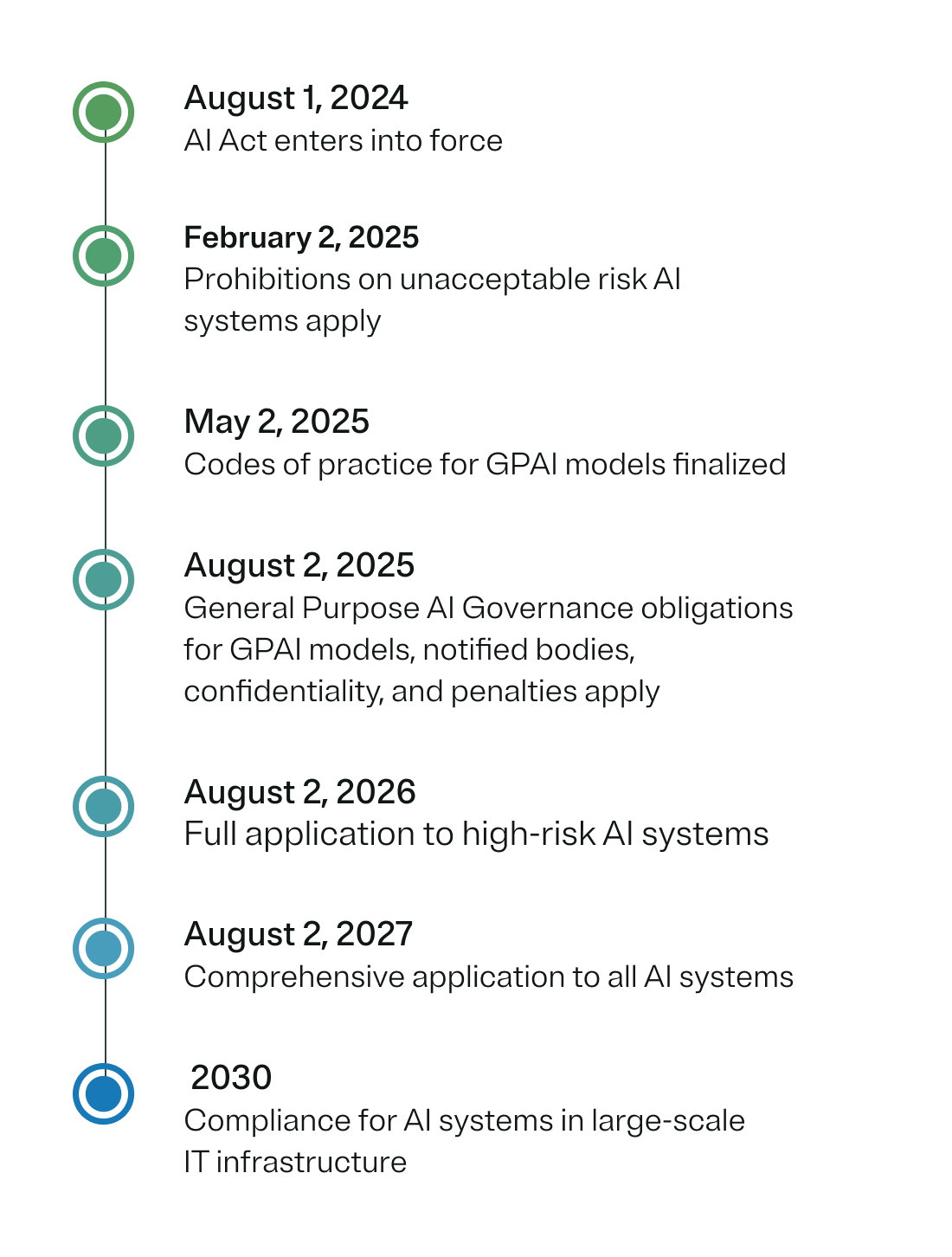

Cronologia delle tappe fondamentali della Conformità della legge dell'UE sull'IA

L'applicazione della legge dell'Unione europea sull'IA è iniziata nell'agosto 2024 ed è proseguita in fasi. Le norme fondamentali per i sistemi di intelligenza artificiale ad alto rischio e di uso generale entreranno in vigore dal 2025 al 2027. Per le infrastrutture su larga scala si prevede la piena conformità entro il 2030.

Domande frequenti

Siamo qui per condividere le nostre conoscenze relative alla legge sull'intelligenza artificiale della Commissione europea e per aiutare la tua azienda a prepararsi implementando la governance dell'IA e le opportune misure di salvaguardia dei dati. Leggi le risposte alle domande frequenti qui sotto.

La legge dell'Unione europea sull'IA stabilisce tre livelli di rischio ammissibile per l'intelligenza artificiale: elevato, limitato e minimo. I sistemi di IA ad alto rischio rappresentano una minaccia significativa per i diritti e le libertà fondamentali di individui o gruppi. Se il livello di rischio di un'organizzazione è superiore a "rischio limitato" ed è, ad esempio, "rischio inaccettabile", questa deve sottoporsi a una valutazione di conformità e/o adeguare i modelli di IA affinché possano essere resi disponibili come servizio o utilizzati.

Oltre a definire i livelli di rischio, la legge sull'intelligenza artificiale dell'UE specifica le aspettative dei seguenti gruppi che interagiscono con l'IA:

- Fornitori: coloro che costruiscono sistemi basati sull'IA per immetterli sul mercato.

- Deployer: coloro che incorporano i sistemi basati sull'IA nei loro prodotti o servizi.

- Utenti: coloro che sono interessati dalle decisioni relative ai sistemi basati sull'IA.

Analogamente al GDPR, la legge sull'intelligenza artificiale dell'UE ha una copertura estremamente ampia. La legge riguarda il trattamento dei dati personali con ''mezzi parzialmente o esclusivamente automatizzati'', compresi i sistemi di intelligenza artificiale.