Zentrale Erkenntnisse

- Der EU AI Act verlagert den Fokus von freiwilligen KI-Prinzipien hin zu verbindlicher, risikobasierter Governance.

- Die Verordnung ist am 1. August 2024 in Kraft getreten und wird in mehreren Phasen bis 2027 in den EU-Mitgliedstaaten angewendet, wobei einige Verpflichtungen bereits früher wirksam werden.

- Für viele Organisationen liegt die eigentliche Herausforderung nicht in der Klassifizierung, sondern in der operativen Umsetzung.

- Hochrisikosysteme erfordern klare Zuständigkeiten, kontinuierliche Überprüfung und belastbare Nachweise.

- Deutsche Organisationen sind am besten aufgestellt, wenn KI-Governance in bestehende Risiko-, Sicherheits- und Compliance-Programme integriert ist.

Was die KI-Regulierung für deutsche Organisationen wirklich verändert

Der EU AI Act schafft den ersten umfassenden, risikobasierten Regulierungsrahmen für künstliche Intelligenz in Europa. In Deutschland erfolgt die Durchsetzung über nationale Aufsichtsbehörden, die in den EU-weiten Rahmen eingebettet sind. Die Verordnung ist am 1. August 2024 in Kraft getreten und wird ab August 2027 in allen EU-Mitgliedstaaten vollständig anwendbar sein. Für Organisationen in Deutschland bedeutet dies mehr als neue Dokumentationspflichten. Es signalisiert einen strukturellen Wandel der Governance-Erwartungen.

Aufsichtsbehörden prüfen zunehmend nicht mehr nur, ob Richtlinien existieren, sondern ob Governance in der Praxis tatsächlich funktioniert. Der Fokus liegt verstärkt darauf, wie Risiken identifiziert werden, wie Verantwortlichkeiten zugewiesen sind und wie die Aufsicht dauerhaft gewährleistet wird.

Infolgedessen wird KI nicht länger primär als Innovations- oder IT-Initiative betrachtet. Sie ist eine Governance-Frage mit klaren Anforderungen an Verantwortlichkeit.

Für viele Organisationen wird dabei eine Lücke zwischen KI-Ambitionen und Governance-Reife sichtbar. Risikoanalysen, Systeminventare, Verantwortlichkeitsmodelle und Aufsichtsprozesse müssen aufeinander abgestimmt und kontinuierlich gepflegt werden.

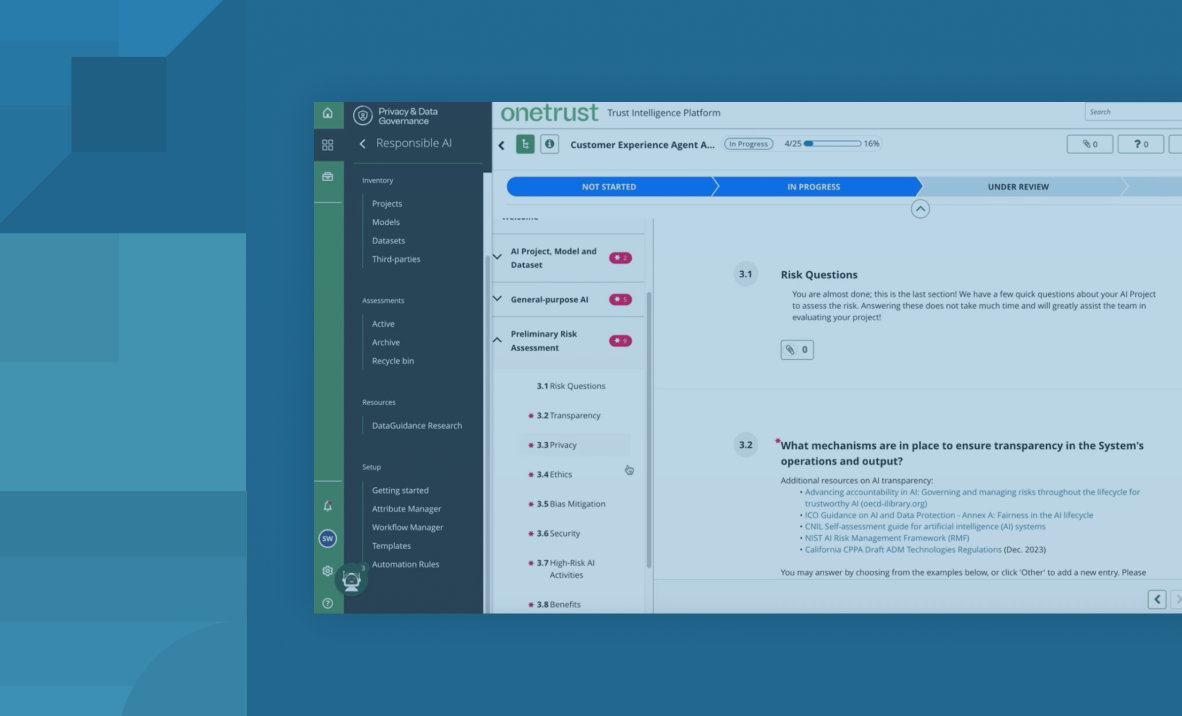

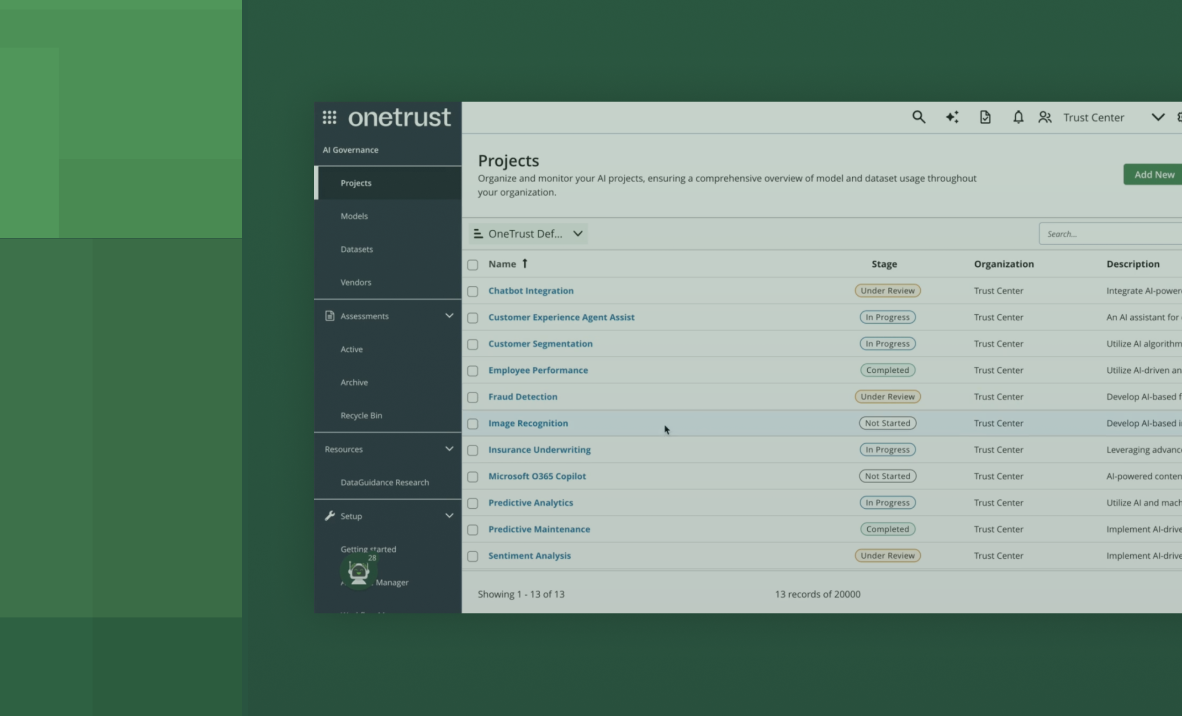

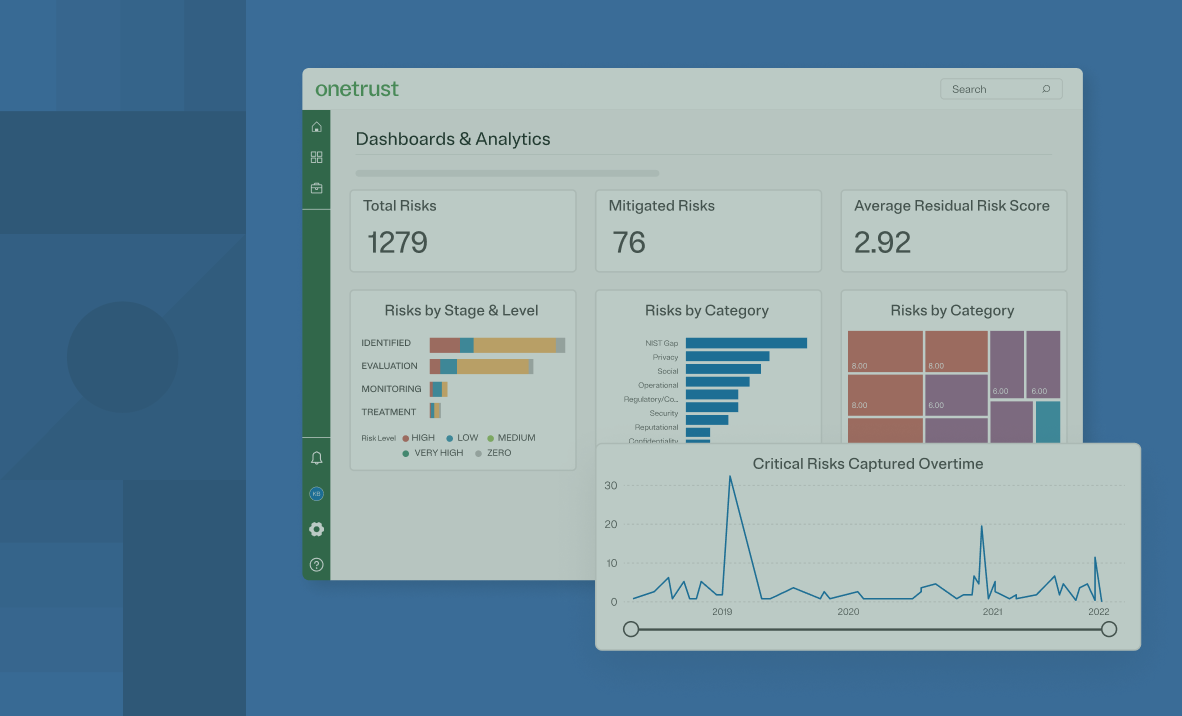

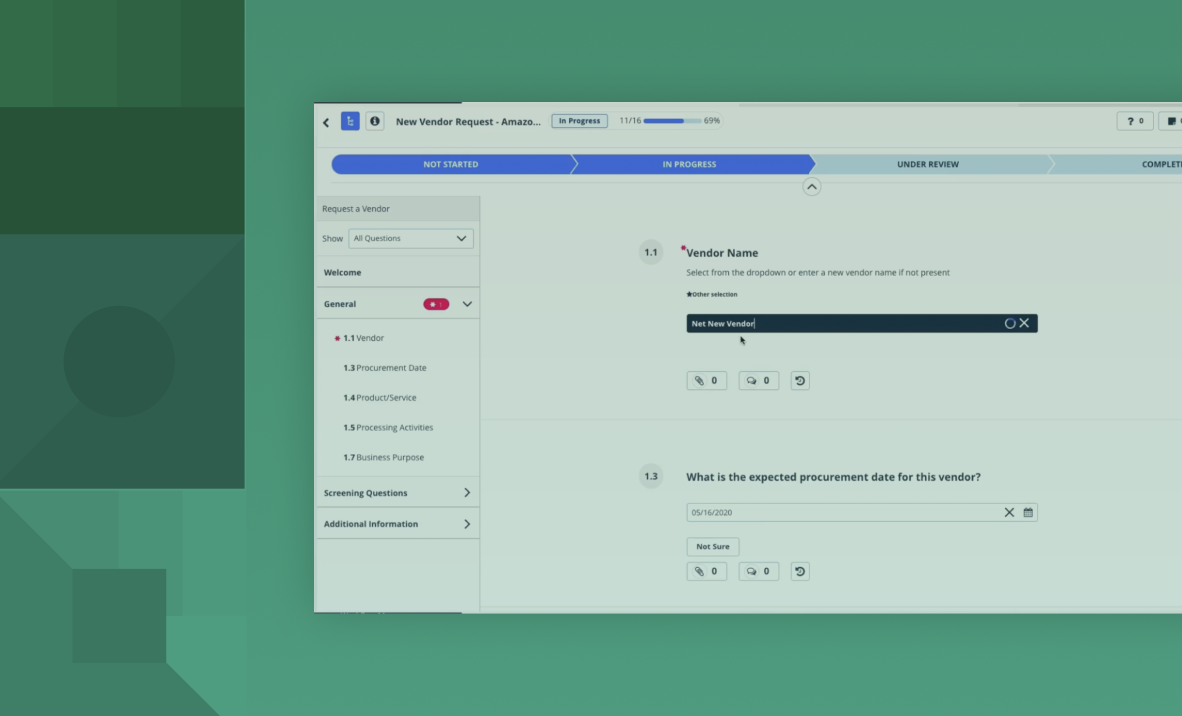

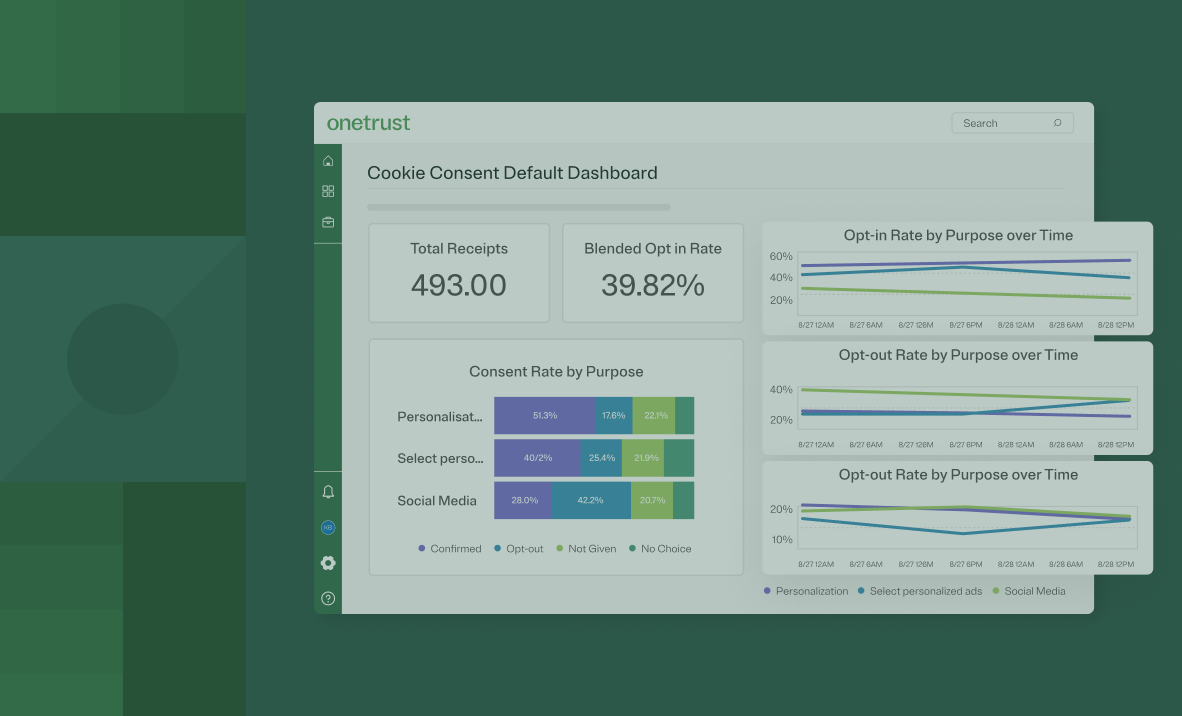

Hier kommen vernetzte Governance-Plattformen wie OneTrust ins Spiel: Sie ermöglichen es Organisationen, KI-Inventare zu zentralisieren, Risikoklassifizierungen mit regulatorischen Anforderungen abzugleichen und belastbare Nachweise über den gesamten Lebenszyklus von Systemen hinweg zu führen.

Risikokategorien sind nur der Ausgangspunkt

Der EU AI Act unterscheidet zwischen verbotenen, Hochrisiko-, begrenzten und minimalen Risiko-KI-Systemen. Dieses Klassifizierungssystem schafft Struktur, führt jedoch nicht automatisch zu operativer Bereitschaft.

Verbotene Anwendungen sind eng definiert und gelten nur für spezifische Szenarien. Systeme mit minimalem Risiko unterliegen vergleichsweise geringen Transparenzpflichten.

Die größten operativen Auswirkungen ergeben sich bei Hochrisikosystemen. Diese erfordern in der Regel:

- strukturierte Risikomanagementprozesse,

- dokumentierte technische und organisatorische Maßnahmen,

- wirksame menschliche Aufsicht und

- nachvollziehbare Entscheidungsprozesse.

In der Praxis bedeutet dies, dass Governance nicht theoretisch bleiben kann. Die Einstufung als Hochrisiko bringt fortlaufende Verpflichtungen mit sich, die auch bei Veränderungen der Systeme Bestand haben müssen.

Gleichzeitig reicht die bloße Klassifizierung nicht aus, um Compliance sicherzustellen. Die größere Herausforderung besteht darin, die Übereinstimmung aufrechtzuerhalten, wenn sich Modelle weiterentwickeln, Datenquellen ändern oder Anwendungsfälle ausgeweitet werden. Ohne wiederholbare Prüfmechanismen und dauerhafte Aufsicht können selbst korrekt klassifizierte Systeme im Laufe der Zeit aus der Compliance geraten.

Von der Klassifizierung zur Governance

Viele Organisationen konzentrieren sich zunächst darauf, festzustellen, ob ein System als Hochrisiko einzustufen ist. Nachhaltige Compliance hängt jedoch davon ab, was nach dieser Einstufung geschieht.

Wirksame Governance erfordert in der Praxis:

- ein aktuelles KI-Inventar, das Systeme, Zwecke und zugehörige Risiken dokumentiert,

- klar definierte Verantwortlichkeiten für jedes relevante System,

- ausgelöste Überprüfungen bei Änderungen an Modellen, Daten oder Einsatzkontexten,

- eine fortlaufende Dokumentation, die Entscheidungen und Anpassungen über die Zeit nachvollziehbar macht.

Fehlen diese Strukturen, schwächt sich Governance schrittweise ab. Verantwortlichkeiten werden implizit statt explizit. Risikoanalysen bleiben an ursprüngliche Annahmen gebunden. Nachweise verteilen sich fragmentiert auf Teams und Tools.

Organisationen, die KI-Governance in eine vernetzte Risiko- und Compliance-Basis integrieren, sind besser in der Lage, eine dauerhafte Aufsicht sicherzustellen. Plattformbasierte Ansätze wie OneTrust verbinden KI-Inventar, Risikoanalyse, Verantwortlichkeiten und Dokumentation innerhalb eines einheitlichen Governance-Rahmens, statt diese isoliert zu verwalten.

KI-Compliance in bestehende Programme integrieren

Der EU AI Act sollte nicht als isolierte KI-Initiative verstanden werden, die zusätzlich zu bestehenden Prozessen eingeführt wird. Organisationen, die besonders effektiv reagieren, stärken vielmehr ihre bereits etablierten Governance-Strukturen, indem sie KI-Aufsicht in bestehende Risiko-, Datenschutz- und Compliance-Programme integrieren.

In der Praxis machen drei operative Schwerpunkte den Unterschied:

- Integration statt Parallelstrukturen: KI-bezogene Risiken werden zusammen mit unternehmensweiten Risiken gesteuert und nicht in einem separaten Prozess.

- Governance-Trigger: Änderungen an Systemen, Modellen oder Daten lösen automatisch strukturierte Überprüfungen und Neubewertungen aus.

- Kontinuierliches Evidenzmanagement: Dokumentation wird als Teil des laufenden Betriebs gepflegt und nicht erst bei regulatorischer Prüfung zusammengetragen.

Diese Disziplinen reduzieren Reibungsverluste bei sich weiterentwickelnden regulatorischen Leitlinien und unterstützen Konsistenz über Geschäftsbereiche und Regionen hinweg. Gleichzeitig stärken sie die Aufsicht auf Führungsebene, indem Zuständigkeiten, Entscheidungen und Anpassungen über die Zeit hinweg transparent bleiben.

Nachhaltige KI-Governance entsteht, wenn Verantwortlichkeiten, Kontrollen und Nachweise innerhalb eines einheitlichen Betriebsmodells gemanagt werden – nicht als Abfolge isolierter Compliance-Aufgaben.

Governance wird zum Differenzierungsmerkmal

Der EU AI Act führt nicht nur neue Compliance-Pflichten ein, sondern verändert auch, wie Vorbereitung bewertet wird.

Mit steigenden aufsichtsrechtlichen Erwartungen ist der entscheidende Unterschied nicht mehr, ob eine Organisation KI-Prinzipien dokumentiert oder eine initiale Klassifizierung vorgenommen hat. Entscheidend ist, ob Governance auch dann kohärent bleibt, wenn sich Systeme weiterentwickeln, Teams wechseln und Anwendungsfälle zunehmen.

Behörden werden verstärkt prüfen, ob Verantwortlichkeit dauerhaft gewährleistet ist: Können Zuständigkeiten heute klar benannt werden – nicht nur zum Projektstart? Werden Risikoanalysen bei Änderungen an Modellen oder Daten aktualisiert? Ist die Dokumentation eng mit realen operativen Entscheidungen verknüpft, statt nachträglich zusammengestellt zu werden?

Organisationen, die KI-Governance in ihre umfassenden Risiko- und Compliance-Strukturen einbetten, sind besser auf diese Erwartungen vorbereitet. Aufsicht wird zu einem festen Bestandteil der Unternehmenspraxis und nicht zu einer punktuellen Compliance-Maßnahme.

OneTrust unterstützt dieses Betriebsmodell, indem es Organisationen hilft, KI-Inventare zu zentralisieren, Risikoklassifizierungen mit Governance-Workflows zu verknüpfen und belastbare Nachweise sicherzustellen, während der regulatorische Prüfungsdruck zunimmt.